La irrupción de la inteligencia artificial generativa abrió una nueva etapa en el desarrollo de herramientas capaces de interactuar con los usuarios. Sin embargo, en el ecosistema tecnológico actual comienza a consolidarse una evolución clara: el paso de los chatbots conversacionales a los agentes de inteligencia artificial capaces de ejecutar acciones y tomar decisiones dentro de procesos empresariales.

Ese fue uno de los ejes centrales de la conversación con Pablo Fernández Hinojosa, CTO de Raona, durante una entrevista realizada en Future Talks, el programa de streaming producido por ITSitio. Allí, el ejecutivo analizó cómo están evolucionando estas tecnologías, qué desafíos enfrentan las organizaciones al adoptarlas y cuáles son los casos de uso concretos que ya están transformando operaciones en distintos sectores.

De los chatbots a los agentes de IA

Para Fernández Hinojosa, la evolución de la inteligencia artificial puede entenderse en distintas generaciones. Según explicó, la primera gran ola estuvo marcada por la popularización de los chats conversacionales, encabezados por herramientas como ChatGPT, que revolucionaron la forma en que los usuarios interactúan con los modelos de lenguaje.

“Esto viene con la generación de la inteligencia artificial, las diferentes generaciones. Creo que la primera generación son estos chats conversacionales, el más famoso es el chat GPT que hizo la verdadera revolución”, señaló.

Sin embargo, el desarrollo no se detuvo allí. El CTO de Raona explicó que las empresas están comenzando a adoptar una segunda generación de soluciones: los agentes de inteligencia artificial. A diferencia de los chatbots tradicionales, estos sistemas no solo responden preguntas, sino que ejecutan tareas concretas dentro de un entorno de trabajo.

“Son agentes que no solamente son conversacionales, no es que le preguntas algo y solamente te responde, si no está con el siguiente nivel, que ya empiezan a hacer acciones concretas, lo típico, generarme el ticket de avión, créame este ticket de soporte o da de alta un registro de una base de datos”, explicó.

De acuerdo con el especialista, esta capacidad de actuar es precisamente lo que define a los agentes modernos. “Entonces, como la siguiente generación de estos chats conversacionales se empieza a llamar agentes precisamente por eso. No es solamente que conversan, sino que realizan acciones de manera autónoma”, agregó.

Agentes con autonomía (pero con supervisión)

El siguiente paso en esta evolución tecnológica es el desarrollo de agentes con mayor grado de autonomía. Estos sistemas pueden activarse ante determinados eventos —como la llegada de un correo electrónico— y tomar decisiones en función del contexto disponible.

“Los chats ahora en muchos casos son autónomos en el sentido de que se ejecutan solos, ante una acción llega un correo y tal vez se despierta el agente y revisa lo que tiene el correo, revisa los documentos y a partir de eso inclusive puede tomar decisiones”, explicó.

No obstante, Fernández Hinojosa subrayó que incluso en estos escenarios la intervención humana sigue siendo clave. El concepto conocido como human in the loop —un humano dentro del circuito de decisiones— es fundamental para evitar errores o decisiones críticas tomadas sin supervisión.

“Entonces ya son agentes con un cierto grado de autonomía. Bueno, ahí también hay un concepto muy importante que es el human in the loop”, señaló.

En muchos casos, explicó, los agentes están diseñados para consultar al usuario antes de ejecutar determinadas acciones.

“En ese caso tengo esta situación, estoy revisando este documento y este otro y tengo esta situación. ¿qué voy a hacer? Y le preguntan al humano”, detalló.

El equilibrio entre automatización y control humano depende del caso de uso específico. En procesos altamente repetitivos, el objetivo puede ser reducir al mínimo la intervención de las personas. Pero en otros escenarios, la supervisión resulta esencial.

“En la mayoría de los casos es una buena práctica, digamos que no sea 100% autónomo, que el agente no sea el que decide absolutamente todo, que esté dentro de criterios y parámetros donde el humano sea el que tenga esa posibilidad de decidir las cosas más importantes”, afirmó.

Plataformas para desarrollar agentes

La explosión del interés por los agentes de IA también impulsó la aparición de numerosas herramientas para desarrollarlos. Según el CTO de Raona, el ritmo de innovación en este campo es vertiginoso.

“La industria de software está sobre esto y hay un montón, es un mundo. Es impresionante la cantidad de herramientas que salen todos los días, todas las semanas”, comentó.

En el caso de Raona, la compañía trabaja principalmente sobre la plataforma de Microsoft y su ecosistema de inteligencia artificial.

“Microsoft tiene una estrategia de IA con todo esto y una de las herramientas fuertes que tiene Microsoft es toda la familia de Copilots”, explicó.

Dentro de ese ecosistema, Copilot Studio permite construir agentes sobre la infraestructura de Azure, lo que aporta un entorno seguro para manejar datos y conversaciones empresariales.

“Copilot Studio, por ejemplo, está dentro de una plataforma que ya tiene todo asegurado para que las conversaciones sean seguras, para que los modelos de lenguaje que están atrás estén asegurados de que esas conversaciones no se van a filtrar”, sostuvo.

El objetivo principal, según explicó el ejecutivo, es que estas herramientas se utilicen para resolver problemas reales en las organizaciones.

“Siempre nosotros tratamos de que la IA sea aplicable… que se solucionen problemas reales a un costo razonable”, señaló.

Cuánto tiempo lleva desarrollar un agente

El tiempo necesario para desarrollar un agente puede variar significativamente según la complejidad del proyecto. Fernández Hinojosa explicó que las primeras pruebas pueden desarrollarse con relativa rapidez, especialmente cuando las herramientas están diseñadas para usuarios de negocio.

“La idea inicial es que un usuario de negocio, alguien que no sabe de tecnología, no sabe programar, pueda hacer sus propios agentes”, explicó.

En esos casos, un prototipo puede construirse en pocos días.

“Generalmente eso tarda una semana en hacerlo, es una prueba de concepto del agente”, indicó.

Sin embargo, cuando el objetivo es transformar un proceso completo dentro de una empresa, los tiempos cambian.

“Ese agente puede demorar meses en hacerse, para llegar a ese objetivo”, aclaró.

Casos de uso en la industria

Durante la entrevista, el CTO de Raona compartió algunos ejemplos concretos de cómo se están aplicando estos agentes en entornos industriales y administrativos.

Uno de ellos corresponde al sector energético, donde los trabajadores de campo deben registrar incidentes o fallas en instalaciones como pozos petroleros.

En ese contexto, la interacción con sistemas tradicionales resulta incómoda y poco práctica.

“Hay un operador en un pozo petrolero… entonces pedirle que llene un formulario a veces es una tarea de decirle: cuando encuentras un problema tienes que llenar todo este formulario”, explicó.

La solución consiste en utilizar agentes de IA que permiten registrar la información mediante lenguaje natural, utilizando dispositivos móviles.

“Lo ideal sería, en lugar de tener que seleccionar opciones de menú, hablarle a un asistente”, señaló.

En este caso, la inteligencia artificial no solo facilita el proceso, sino que también resuelve un problema operativo clave: muchos incidentes simplemente no se registraban debido a la dificultad del procedimiento.

“En este caso, el problema a solucionar era que todos estos registros de problemas sean registrados, porque en muchos casos se veía un problema y se daba por alto”, indicó.

Otro caso presentado durante la conversación corresponde al proceso de evaluación de becas en instituciones educativas. Allí, los agentes permiten revisar documentación, comparar datos y reducir el trabajo manual.

“El objetivo ahí es disminuir al máximo ese trabajo manual repetitivo que normalmente lo hacen colaboradores”, explicó.

Riesgos y buenas prácticas

El avance de los agentes autónomos también plantea nuevos desafíos en materia de seguridad. Los errores en la interpretación del contexto pueden generar consecuencias importantes, como sucedió en algunos incidentes recientes vinculados a herramientas de automatización.

Según Fernández Hinojosa, los agentes pueden equivocarse con frecuencia si no reciben el contexto adecuado.

“Los agentes se equivocan frecuentemente, porque tienen que hacer interpretación de un contexto”, afirmó.

Por eso, una de las mejores prácticas es diseñar sistemas que soliciten confirmación antes de ejecutar acciones críticas.

“En los casos en los que hay mínimos, por ejemplo, incertidumbres en el tema, es siempre recomendable que el que termine decidiendo sí, va a ser humano”, sostuvo.

El futuro de los agentes personales

Además de su impacto en el mundo corporativo, el especialista también ve un futuro cercano en el desarrollo de agentes personales instalados en computadoras o dispositivos domésticos.

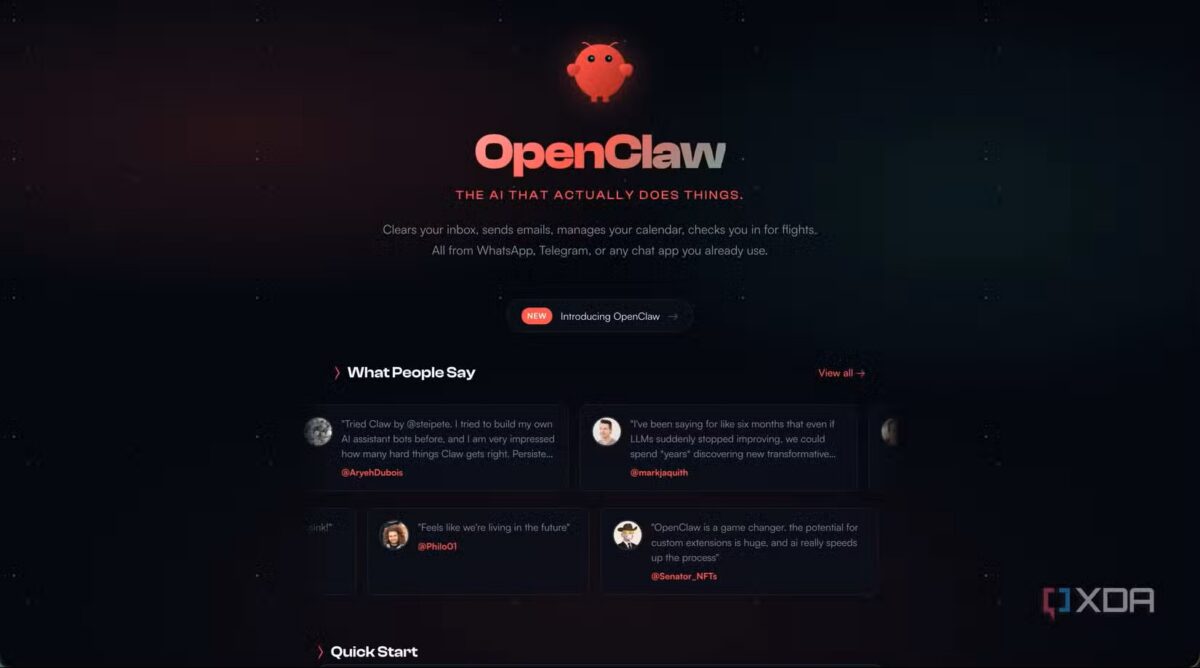

Herramientas experimentales como OpenClaw apuntan precisamente en esa dirección.

“OpenClaw es la siguiente generación a todo lo que hablamos… lo que van a hacer estos agentes autónomos personales y en mi máquina, o sea, un asistente personal”, explicó.

No obstante, el ejecutivo advirtió que estas tecnologías todavía deben evolucionar en términos de seguridad y uso responsable.

“Obviamente que no hay que instalarlo en la máquina personal y no hay que darle todas las contraseñas”, advirtió.

Aun así, considera que estos sistemas representan un anticipo del futuro de la interacción con la inteligencia artificial.

“No deja de ser algo que está empezando y que seguramente el día de mañana cuando se empiece a afinar todo esto va a ser el futuro de los agentes personales”, concluyó.

Leer más

- Vertex AI y un ecosistema de agentes inteligentes interconectados

- Accenture expande AI Refinery y lanza nuevas soluciones de agentes industriales inteligentes

- Lanzan la primera plataforma vibe-code desarrollada en Argentina para crear agentes de IA