Desde que se comenzaron a comercializar sus servicios de manera masiva, la discusión sobre riesgos de la inteligencia artificial aplicada al usuario final estuvo dominada por los sesgos, errores de razonamiento, alucinaciones y exposición de datos hacia servicios en la nube. Hoy se redefine por completo el escenario de riesgo con la aparición de agentes de IA locales, capaces de ejecutarse directamente sobre el sistema operativo del usuario y de interactuar con archivos, navegadores, clientes de mensajería y APIs externas.

Herramientas como Clawdbot u OpenClaw no representan simplemente una “mejor versión” de los asistentes de IA. Introducen un cambio cualitativo: la IA deja de ser un sistema que responde y pasa a ser un sistema que actúa. Y lo hace, en muchos casos, con privilegios comparables a los del propio usuario, pero sin los mecanismos de control, auditoría y revocación que la seguridad informática ha desarrollado durante décadas.

El problema central ya no es qué “dice” la IA, sino qué puede hacer en nombre del usuario, de manera persistente, opaca y difícil de verificar.

Agentes IA locales: arquitectura y ruptura del modelo de confianza

Los agentes IA locales se caracterizan por tres elementos técnicos fundamentales:

- Ejecución en el endpoint del usuario (desktop o servidor local).

- Acceso directo a recursos sensibles del sistema operativo.

- Capacidad de tomar decisiones y ejecutar acciones sin intervención humana continua.

A diferencia de los asistentes en la nube, donde el proveedor controla el entorno de ejecución, los agentes locales operan fuera de cualquier trust boundary (límite donde deja de asumirse confianza y empiezan a exigirse controles). El modelo de amenaza ya no se apoya en la seguridad del proveedor, sino en la robustez, frecuentemente inexistente, del software local, sus dependencias y su configuración.

Este escenario encaja con precisión en lo que la Agencia de la Unión Europea para la Ciberseguridad (ENISA) describe como una expansión de la superficie de ataque en sistemas de IA autónomos, donde los riesgos se desplazan desde la inferencia hacia la operación y el control del ciclo de vida completo del agente (https://www.enisa.europa.eu/publications/artificial-intelligence-cybersecurity-challenges?utm_source=chatgpt.com#contentList).

Ejecución local con privilegios elevados: el nuevo “usuario fantasma”

Uno de los patrones más preocupantes observados en este tipo de herramientas es la ejecución con privilegios elevados. Muchos agentes requieren acceso amplio al sistema para cumplir su promesa funcional: leer y escribir archivos, automatizar navegadores, interactuar con clientes de mensajería o lanzar procesos auxiliares.

Desde el punto de vista de seguridad, esto equivale a introducir un usuario fantasma con capacidad de acción continua, pero sin responsabilidad legal, sin conciencia situacional y sin mecanismos de fricción. Si ese agente es comprometido, o simplemente mal diseñado, el impacto es inmediato y profundo.

La literatura técnica es clara en este punto: la combinación de automatización y privilegios elevados sin aislamiento fuerte contradice principios básicos como el de Mínimo Privilegio y el de defensa en Profundidad (https://csrc.nist.gov/publications/detail/sp/800-53/rev-5/final).

Tokens, claves y secretos: el talón de Aquiles recurrente

Otro vector crítico es el manejo de secretos. En los agentes locales, los tokens de acceso, claves API y credenciales de servicios externos se almacenan en texto plano o con mecanismos de protección triviales dentro del sistema de archivos del usuario.

Este patrón, ampliamente documentado en incidentes de seguridad convencionales, adquiere aquí una dimensión mayor: el propio agente puede ser inducido a exfiltrar sus secretos mediante técnicas de Inyección de Prompts persistente o manipulación del contexto local.

OWASP ha incorporado explícitamente estos escenarios en el OWASP LLM Top 10 2025, señalando el almacenamiento inseguro de secretos y la falta de separación entre lógica del agente y datos sensibles como riesgos estructurales en aplicaciones basadas en modelos de lenguaje (https://owasp.org/www-project-top-10-for-large-language-model-applications/).

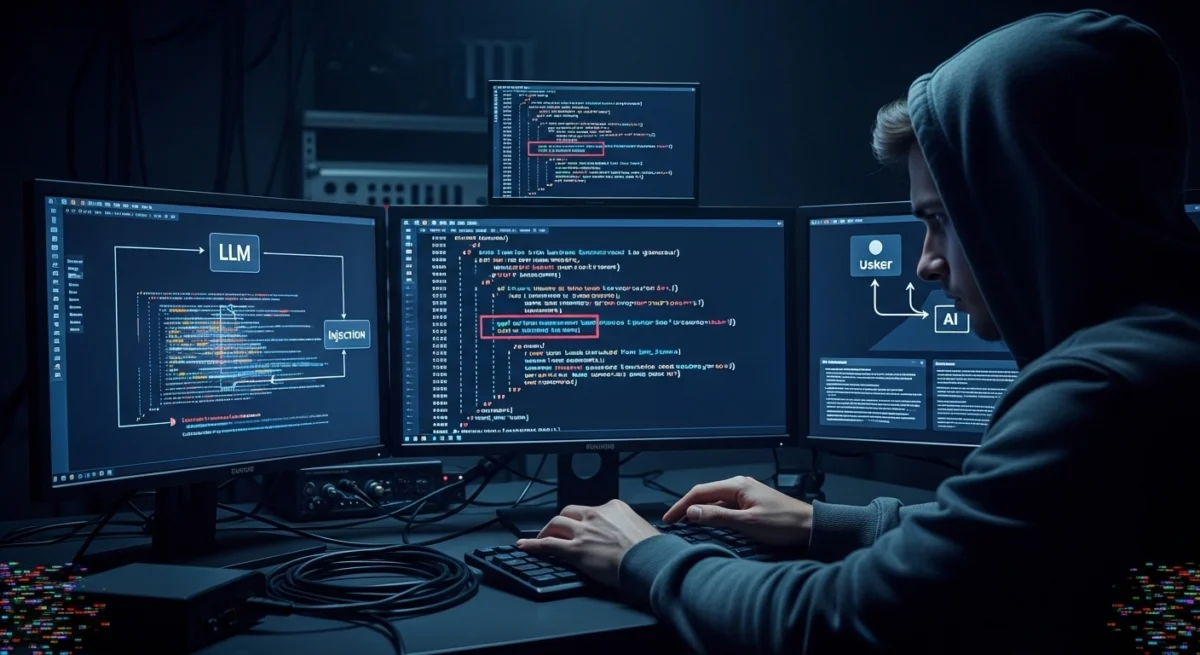

Prompt injection persistente: cuando el sistema de archivos se convierte en el atacante

En el mundo de los agentes locales, el prompt injection deja de ser un ataque efímero basado en texto de entrada y se transforma en un problema persistente. Archivos locales, correos electrónicos, mensajes de chat o documentos pueden actuar como vectores de instrucciones ocultas que el agente procesa de manera automática y recurrente.

Investigaciones recientes muestran que los modelos de lenguaje no distinguen entre instrucciones “legítimas” y contenido malicioso cuando ambos forman parte del contexto operativo (https://arxiv.org/abs/2302.12173). En un agente con acceso continuo al sistema, esto implica que un archivo malicioso puede modificar su comportamiento durante semanas o meses sin generar alertas.

El resultado es una pérdida efectiva de control por parte del usuario, incluso cuando este cree estar operando en un entorno local y “seguro”.

Ausencia de sandboxing real: la ilusión del aislamiento

Muchos proyectos de agentes locales declaran utilizar contenedores, entornos virtuales o “sandboxes”. En la práctica, estos mecanismos suelen ser incompletos o directamente irrelevantes frente al nivel de acceso concedido.

Un sandbox que permite acceso al sistema de archivos del usuario, al navegador autenticado o a sockets locales carece de valor desde una perspectiva de contención. El aislamiento real exige separación estricta de identidades, recursos y contextos, algo raramente implementado en herramientas orientadas al usuario final (https://www.usenix.org/system/files/usenixsecurity22-bosamiya.pdf).

Extensiones y módulos comunitarios: el riesgo de supply chain trasladado al escritorio

La extensibilidad es uno de los principales atractivos de agentes como Clawdbot u OpenClaw. Sin embargo, la incorporación de skills, plugins o módulos desarrollados por terceros introduce riesgos de supply chain comparables, y a veces superiores, a los observados en ecosistemas de software empresarial.

La ausencia de firma criptográfica, revisión formal de código y verificación de integridad convierte a estos módulos en un vector ideal para ataques dirigidos. Casos recientes en repositorios públicos demuestran que basta una actualización maliciosa para comprometer miles de instalaciones (https://www.cisa.gov/topics/information-communications-technology-supply-chain-security).

En el contexto de agentes IA locales, el impacto es especialmente grave: el módulo no solo ejecuta código, sino que puede influir directamente en el razonamiento y las decisiones del agente.

Mensajería, correo y acciones no trazables

Uno de los ejemplos más críticos del mercado es la conexión directa de agentes a plataformas de mensajería como WhatsApp, Telegram o correo electrónico. Estos agentes pueden leer conversaciones privadas, generar respuestas y ejecutar acciones en nombre del usuario sin un registro claro ni mecanismos de no repudio.

Desde una perspectiva forense, esto plantea un problema crítico: ¿cómo demostrar que una acción fue realizada por el usuario y no por su agente? La falta de trazabilidad y registros confiables socava principios básicos de responsabilidad y control, con implicancias legales y regulatorias aún poco exploradas (https://www.oecd.org/en/topics/ai-principles.html).

Implicancias estratégicas: de la ciberseguridad personal al riesgo sistémico

Aunque estos agentes suelen presentarse como herramientas de productividad individual, su adopción masiva introduce riesgos sistémicos. Un ecosistema donde millones de endpoints ejecutan agentes autónomos con acceso a datos sensibles constituye una superficie de ataque distribuida sin precedentes.

La transición desde “asistentes” hacia asistentes autónomos inseguros, capaces de operar sin supervisión humana efectiva, obliga a repensar modelos de gobernanza, responsabilidad y diseño seguro desde la base.

Conclusión: recuperar el control antes de perderlo

Los agentes IA locales no son, por definición, una mala idea. Representan una evolución lógica hacia sistemas más potentes y personalizados. El problema es que su desarrollo actual avanza mucho más rápido que los marcos de seguridad, control y auditoría necesarios para operarlos de forma responsable.

Clawdbot y herramientas similares son una advertencia temprana: cuando la IA cruza el límite del control del usuario, el riesgo deja de ser teórico. La pregunta ya no es si estos agentes serán comprometidos, sino cuándo y con qué impacto.

Sin un rediseño profundo basado en principios básicos de ciberseguridad como privilegios mínimos, trazabilidad y control criptográfico del código, los agentes IA locales corren el riesgo de convertirse en el eslabón más débil del ecosistema informático.

El desafío no es frenar la innovación, sino evitar que la automatización sin control se transforme en la próxima gran crisis de confianza tecnológica.

Leer más

- Nano Banana 2: Google lanza su nuevo modelo de generación de imágenes con IA ultrarrápida y calidad profesional

- WhatsApp Business suma inteligencia artificial: cómo activar el agente que atiende clientes todo el día

- Security Level Up: la estrategia de Microsoft para fortalecer a socios de negocio en seguridad, IA y nube en LATAM