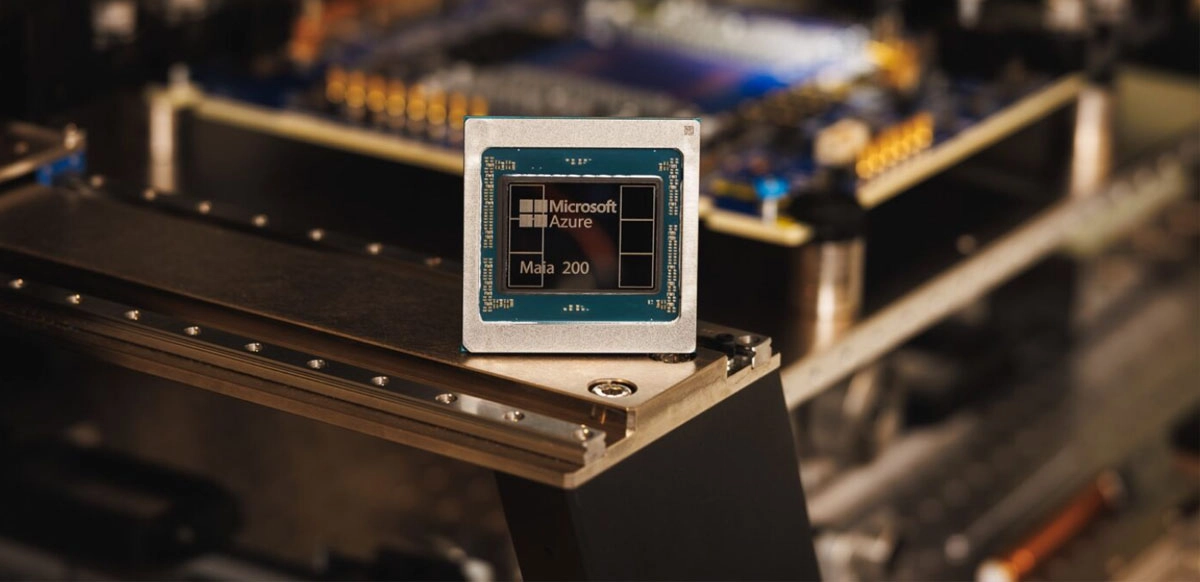

Microsoft dio a conocer Maia 200, su nuevo acelerador de IA de silicio propio, desarrollado específicamente para responder a las crecientes demandas de la inteligencia artificial generativa. Este avance representa un nuevo hito dentro de la estrategia de hardware de la compañía, al permitir ejecutar modelos avanzados de manera más rápida, eficiente y rentable dentro de la plataforma Azure.

Fabricado con el proceso de 3 nanómetros de TSMC, Maia 200 integra más de 140 mil millones de transistores y, según la compañía, se trata del sistema de inferencia más eficiente que Microsoft ha desplegado hasta el momento. En comparación con el hardware más avanzado de su flota actual, ofrece un 30 % más de rendimiento por dólar, optimizando el costo total de operación en la nube.

Diseñado para modelos que utilizan computación de baja precisión, Maia 200 alcanza más de 10 petaFLOPS en FP4 y más de 5 petaFLOPS en FP8, lo que le permite ejecutar sin inconvenientes los modelos de lenguaje más grandes del mercado y prepararse para futuras generaciones. Este enfoque resulta clave para acelerar la inferencia en escenarios de IA a gran escala.

El nuevo acelerador también aborda uno de los principales desafíos de la IA moderna: el movimiento de datos. Para ello, incorpora un sistema de memoria avanzado con 216 GB de HBM3e, 272 MB de SRAM integrada y un ancho de banda de hasta 7 TB/s, lo que se traduce en una generación de tokens más rápida y eficiente y un mejor aprovechamiento del cómputo disponible.

Maia 200 forma parte de la infraestructura heterogénea de IA de Microsoft y será utilizado para ejecutar múltiples modelos, incluidos los más recientes GPT-5.2 de OpenAI. Su despliegue beneficiará directamente a servicios como Microsoft Foundry y Microsoft 365 Copilot, además de ser clave para el trabajo del equipo de Microsoft Superintelligence, reforzando la visión de la compañía de una infraestructura de IA escalable, eficiente y preparada para el futuro.