En exclusiva: Todo lo que necesita saber sobre el procesador de IBM que impulsará Deep Learning desde el chip

ITSitio.com tuvo la oportunidad de participar del anuncio de Telum, en el marco de la conferencia Hot Chips. El chip de IBM incorpora un procesador específico para cargas de trabajo de IA, haciéndolo ideal para aplicaciones de servicios financieros como la detección de fraudes.

El pasado 17 de agosto, y ante un grupo reducido de periodistas y partners de todo el mundo, IBM hizo públicas las características destacadas y el campo de aplicaciones de su procesador Telum para las próximas generaciones de los mainframes IBM z y de servidores LinuxOne. Vale recordar que, hacia fines de julio de este año, la compañía había anunciado IBM z/OS v2.5, un sistema operativo orientado a la habilitación de la IA, la modernización de las aplicaciones, la resistencia, una seguridad superior y una experiencia de desarrollador mejorada.

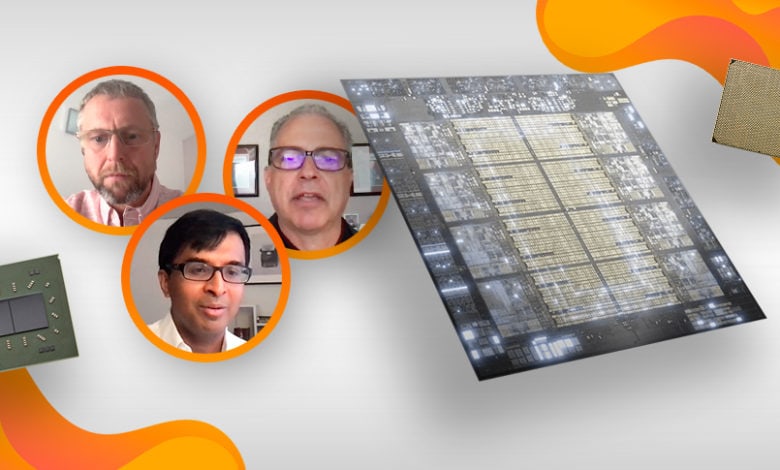

En aquella oportunidad, Ross Mauri, gerente general, IBM z, había explicado: “IBM apuesta por la nube híbrida y la inteligencia artificial, y estamos profundamente enfocados en ofrecer nuevas innovaciones como la inteligencia artificial y las nuevas capacidades de seguridad en IBM z para ayudar a nuestros clientes a avanzar más rápidamente en sus viajes de modernización. Para nuestros clientes, IBM z/OS v2.5 brinda nuevas capacidades de seguridad y resistencia a la plataforma, y permite a los clientes infundir inteligencia artificial en tiempo real en cada transacción comercial, imperativos que se volvieron más urgentes durante la pandemia”. Ahora, en el marco de Hot Chips, Mauri fue uno de los tres especialistas que, de manera escueta, explicaron cómo han mejorado los motores de la próxima generación de la plataforma empresarial para aplicaciones de misión crítica de IBM.

“Los clientes me han dicho durante varios años que querían correr IA, Deep Learning y obtener inferencias en cada una de sus transacciones (…) hablamos de mil, 10.000, 50.000 transacciones por segundo. Estamos hablando de un volumen muy alto, de velocidades muy altas de transacciones que además son complejas, con escrituras y lecturas en múltiples bases de datos. Son transacciones den Banca, Finanzas, Retail, Seguros, etcétera”, expresó Mauri durante el encuentro de Hot Chips, en relación con el contexto de este nuevo procesador. “La innovación está llegando de la mano de IBM Research y el equipo de Ingeniería de IBM z”, agregó.

A su turno, Christian Jacobi, el Arquitecto en jefe del Diseño del nuevo procesador para los sistemas IBM z, explicó que IBM puso mucha innovación en cada una de las dimensiones del nuevo procesador, incluyendo una seguridad y una disponibilidad que son las mejor en su clase, y la optimización del desempeño en las transacciones más pesadas de misión crítica. Acaso esta especificidad en cuanto a las cargas de trabajo y al tipo de procesos críticos que se espera de los sistemas motorizados por el nuevo chip de IBM (en conjunción con el software y el middleware específicos) marquen la primera gran diferencia entre Telum y otros procesadores de la competencia que incluyen algún tipo de capacidad de IA.

A su turno, Christian Jacobi, el Arquitecto en jefe del Diseño del nuevo procesador para los sistemas IBM z, explicó que IBM puso mucha innovación en cada una de las dimensiones del nuevo procesador, incluyendo una seguridad y una disponibilidad que son las mejor en su clase, y la optimización del desempeño en las transacciones más pesadas de misión crítica. Acaso esta especificidad en cuanto a las cargas de trabajo y al tipo de procesos críticos que se espera de los sistemas motorizados por el nuevo chip de IBM (en conjunción con el software y el middleware específicos) marquen la primera gran diferencia entre Telum y otros procesadores de la competencia que incluyen algún tipo de capacidad de IA.

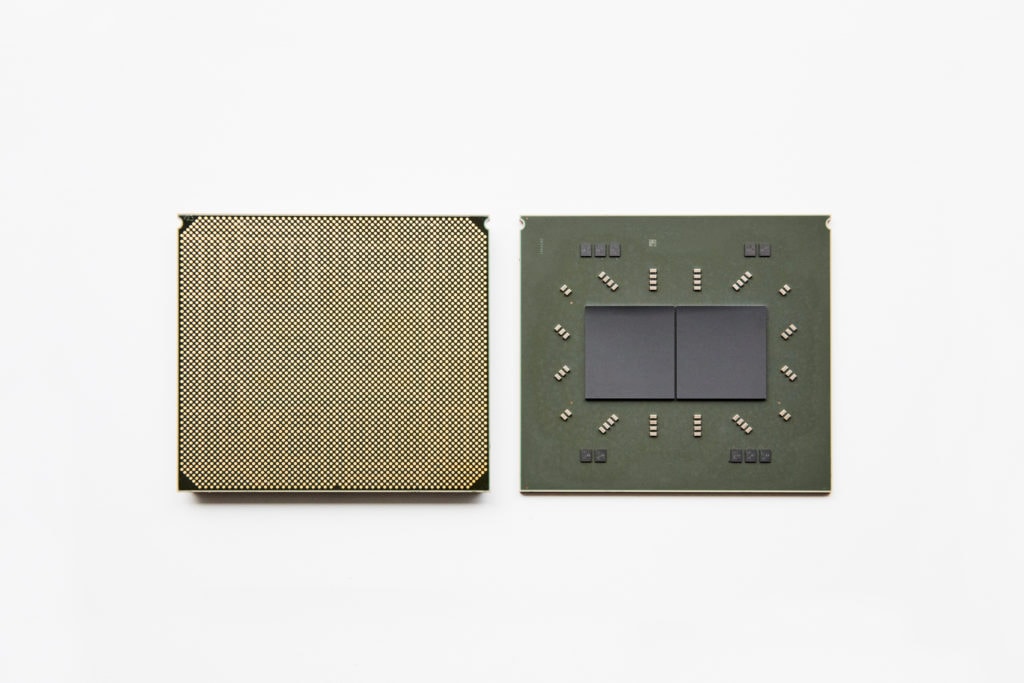

Además de los ocho núcleos de procesamiento que cada chip tiene (especialmente diseñados para brindar un altísimo desempeño en los escenarios transaccionales y de análisis antes mencionados), Jacobi destacó los cachés de 32 MB de nivel 2 que tiene cada uno de esos núcleos, “los cuales pueden cooperar a lo largo de los ocho núcleos del chip y en hasta ocho chips, para formar cachés virtuales de nivel 3 y 4, llegando a 2GB de caché de nivel 4 que se extienden a los ocho chips”. Con todo, la estrella en materia de innovación de este chip, según Jacobi, es el acelerador de IA, “que permite atender la demanda de parte de los clientes de la cual hablaba Ross (Mauri)”. Este acelerador está conectado directamente a la infraestructura de los cachés en el chip para bajar la latencia en tareas de inferencia basada en Deep Learning. De este modo, el procesador de IA puede acceder más velozmente a los datos transaccionales y de modelado directamente desde el caché.

Kailash Gopalakrishnan, del IBM Research, a la sazón uno se los artífices de los núcleos de baja latencia del chip, explicó que su unidad viene innovando en materia de algoritmos de inteligencia artificial y hardware por los últimos cinco a seis años, pero siempre con el foco puesto en el código abierto y en un ecosistema amplio. Telum es el primer producto surgido de este ecosistema. Esto cristalizó en junio de 2019 en el AI Hardware Center, del cual este chip es el primer producto. Este centro trabaja de la mano de partners de la Industria y la Academia, y en la actualidad cuenta con 16 miembros.

¿Qué necesita saber?

En el marco de Hot Chips, IBM dio precisiones sobre su procesador Telum, que estará en el corazón de sus mainframes de decimosexta generación:

- IBM Telum es el primer procesador que contiene aceleración para inferencia de Inteligencia Artificial desde el chip.

- Telum está diseñado para llevar la inferencia de Deep Learning a cargas de trabajo empresariales para ayudar a abordar el fraude en tiempo real.

- La aceleración de Telum está muy cerca de los datos y aplicaciones de misión crítica, permitiendo altos volúmenes de inferencias en tiempo real.

- Telum es el primer chip de IBM con tecnología creada por el AI Hardware Center de IBM Research. Telum es fabricado por Samsung.

- Se espera que el primer sistema imbuido con esta tecnología (IBM z ó LinuxOne) esté disponible en el primer semestre de 2022.

La industria financiera, de parabienes

Con un desarrollo que llevó cerca de tres años, Telum es el primer procesador de IBM que contiene aceleración para la inferencia de Inteligencia Artificial (AI) desde el chip, proceso que se realiza al mismo tiempo que la transacción se está realizando. Así, la aceleración del hardware fue concebida para ayudar a los clientes para obtener insights de negocio a escala en aplicaciones bancarias, financieras, comerciales, de seguros e interacciones con los clientes.

Adicionalmente, IBM Telum fue diseñado para permitir a las aplicaciones correr eficientemente donde residen los datos, ayudando a superar los enfoques tradicionales de IA empresarial que tienden a requerir una cantidad significativa de memoria y capacidades para mover los datos para gestionar la inferencia. Aquí surge el concepto de aceleración cercana (en proximidad) para los datos de misión crítica y las aplicaciones, todo lo cual permite a las organizaciones realizar un alto volumen de inferencias para transacciones sensibles en tiempo real, sin tener que llamar soluciones de IA fuera de la plataforma (evitando al mismo tiempo que se degrade el desempeño).

Los clientes también pueden construir y entrenar modelos de IA fuera de la plataforma, desplegar e inferir para análisis en un sistema IBM habilitado para Telum.

Los clientes también pueden construir y entrenar modelos de IA fuera de la plataforma, desplegar e inferir para análisis en un sistema IBM habilitado para Telum.

El chip se caracteriza por un diseño centralizado que les permite a los clientes aprovechar completamente el poder de un procesador de IA para estas cargas de trabajo específicas. Por este motivo, resulta ideal para cargas de trabajo de servicios financieros como la detección de fraudes, el procesamiento de préstamos, las compensaciones y la liquidación de valores, la lucha contra el lavado de dinero y el análisis de riesgos. Con estas innovaciones, los clientes estarán posicionados para mejorar las reglas existentes de detección de fraude o para utilizar el Machine Learning, acelerar los procesos de aprobación de créditos, mejorar el servicio al cliente y la rentabilidad, identificar qué operaciones o transacciones pueden fallar y proponer soluciones para crear un proceso de conciliación más eficiente.

Los números de Telum

El chip contiene 8 núcleos de procesador con un pipeline profundo superescalar de instrucciones desordenadas, ejecutándose con una frecuencia de reloj de más de 5GHz, optimizada para las demandas de cargas de trabajo heterogéneas de clase empresarial.

La infraestructura de caché e interconexión de chip totalmente rediseñada proporciona 32MB de caché de nivel 2 por núcleo, y puede escalar hasta 32 chips de Telum. El diseño del módulo dual del chip contiene 22 mil millones de transistores y 19 millas de cable en 17 capas de metal.

Telum es el primer chip de IBM con tecnología creada por el AI Hardware Center de IBM Research. Además, Samsung es el aliado de IBM para el desarrollo de tecnología para el procesador Telum, desarrollado en el nodo de tecnología 7nm EUV. En estos días IBM Research anunció el escalamiento al nodo 2nm, con todo lo que ello significa en términos de velocidad, ahorro en el consumo y desempeño en general.

Telum es el primer chip de IBM con tecnología creada por el AI Hardware Center de IBM Research. Además, Samsung es el aliado de IBM para el desarrollo de tecnología para el procesador Telum, desarrollado en el nodo de tecnología 7nm EUV. En estos días IBM Research anunció el escalamiento al nodo 2nm, con todo lo que ello significa en términos de velocidad, ahorro en el consumo y desempeño en general.